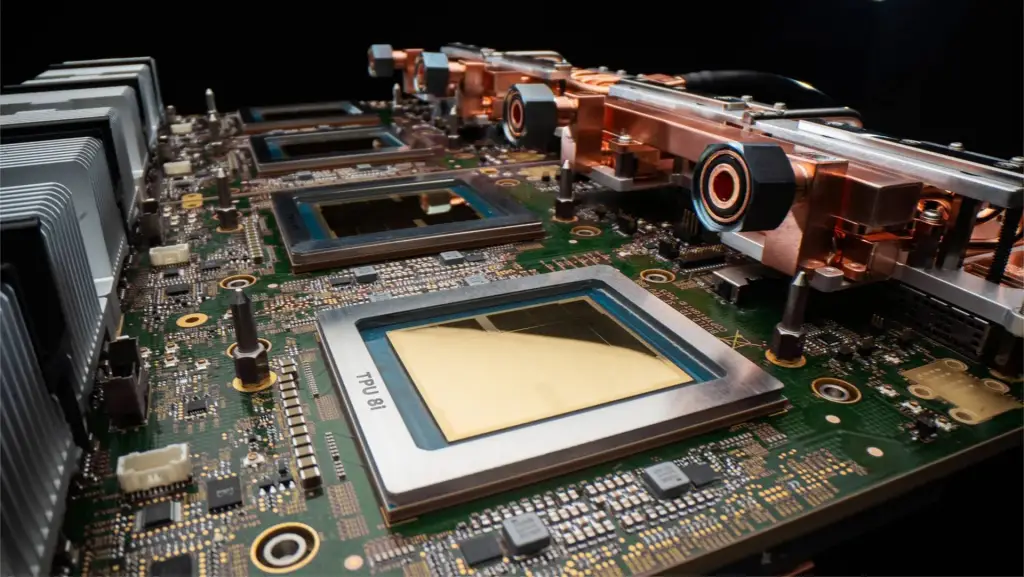

Google acaba de anunciar su octava generación de procesadores enfocados al desarrollo de nuevas IA. Aprovechando el inicio de su evento Google Cloud Next, la tecnológica presentó los TPU 8t y TPU 8i, dos chips con perfiles diferentes que se enfocan en una tarea concreta. Los procesadores están pensados para competir directamente con las GPU de NVIDIA a la hora de entrenar e implementar modelos.

De acuerdo con una publicación en el blog de la compañía, los nuevos chips han sido diseñados junto a DeepMind. Google anticipó hace unos años que el entrenamiento y la inferencia acabarían teniendo necesidades tan distintas que un solo chip no podría cumplor. Con la llegada de los agentes de IA, los modelos ahora deben operar en bucles continuos de razonamiento y ejecución, por lo que se necesitan dos soluciones distintas.

En términos de rendimiento, el TPU 8t es la opción de potencia bruta. Un superpod de estos chips escala hasta 9.600 unidades y dos petabytes de memoria compartida, lo que se traduce en 121 exaflops de cómputo para entrenar modelos de IA. Google promete un acceso a almacenamiento diez veces más rápido y una eficiencia de cómputo útil superior al 97%, lo que en la práctica significa menos tiempo perdido por fallos o reinicios durante el entrenamiento.

El TPU 8i tiene un perfil diferente, más enfocado en eliminar la latencia que en maximizar el volumen de cálculo. Este chip incorpora 288 GB de memoria HBM y 384 MB de SRAM, el triple que la generación previa. También duplica el ancho de banda de interconexión hasta 19,2 Tb/s y añade un motor de aceleración que reduce la latencia en chip hasta cinco veces.

Los nuevos TPU de Google están diseñados para los modelos de IA actuales

Según la compañía, tanto el TPU 8t como el TPU 8i se construyeron pensando en los modelos que van a ejecutar. Por ejemplo, la topología Boardfly del TPU 8i se diseñó específicamente para los requisitos de comunicación de los modelos de razonamiento avanzado, como Gemini 3.1 Pro o Claude Opus. Mientras tanto, la red Virgo del TPU 8t se calibró a partir de las necesidades de paralelismo de modelos con billones de parámetros.

Por primera vez, ambos chips funcionan sobre CPUs propias de Google basadas en la arquitectura ARM Axion, lo que permite optimizar el sistema completo en lugar de solo el procesador acelerador. En cuanto a software, los dos son compatibles con JAX, PyTorch, SGLang y vLLM, los frameworks más usados en el sector, y ofrecen acceso bare metal sin capas de virtualización.

En términos de eficiencia energética, los chips de Google mejoran el rendimiento por vatio hasta dos veces respecto a la generación Ironwood. Los chips utilizan refrigeración líquida para mantener densidades de rendimiento que el aire no sería capaz de sostener.

Google no reveló la fecha de lanzamiento de los TPU 8t y TPU 8i, pero confirmó que llegarán este año a su plataforma AI Hypercomputer. La compañía no solo busca reducir la dependencia de NVIDIA, sino robarle una cuota de mercado que podría generarle hasta 13.000 millones de dólares en sus ingresos para 2027. A diferencia de las GPUs con CUDA, los chips de Google apuestan por el rendimiento y la eficiencia energética.

Seguir leyendo: Google lanza dos nuevos chips de IA que prometen entrenar modelos tres veces más rápido